pibitek.biz - Kamu mungkin pernah ngobrol dengan chatbot AI, misalnya di website atau aplikasi tertentu. Tapi tahukah kamu bahwa obrolanmu itu bisa saja disimpen, direview, atau bahkan dijual sama pihak yang bikin chatbotnya? Gue punya pengalaman buruk soal ini. Pas kuliah tahun 2004 (gue udah tua), gue pasang plugin AI yang bisa jawab otomatis pesan AIM (jaman dulu) pas gue lagi off.

2 – Serangan MFA Makin Marak, Microsoft Beri Tips Keamanan 2 – Serangan MFA Makin Marak, Microsoft Beri Tips Keamanan

3 – Superlist, Aplikasi To-Do Baru dari Pembuat Wunderlist 3 – Superlist, Aplikasi To-Do Baru dari Pembuat Wunderlist 300x600

Plugin ini jawab pesannya pake histori chat gue. Jadi kalau ada yang nanya "How are you?", chatbotnya bakal jawab pake jawaban gue yang terakhir. Tau sendiri kan akibatnya: cuma dua hari, chatbotnya ngulang sesuatu yang gue bilang jelek tentang temen gue ke temen gue itu sendiri.

Gue langsung hapus pluginnya, sambil belajar tentang privasi AI (dan persahabatan). AI udah berkembang banget dalam 20 tahun, tapi masalah privasinya tetap aja. Apa pun yang kamu bilang ke chatbot AI bisa aja dibaca atau diulang sama orang lain.

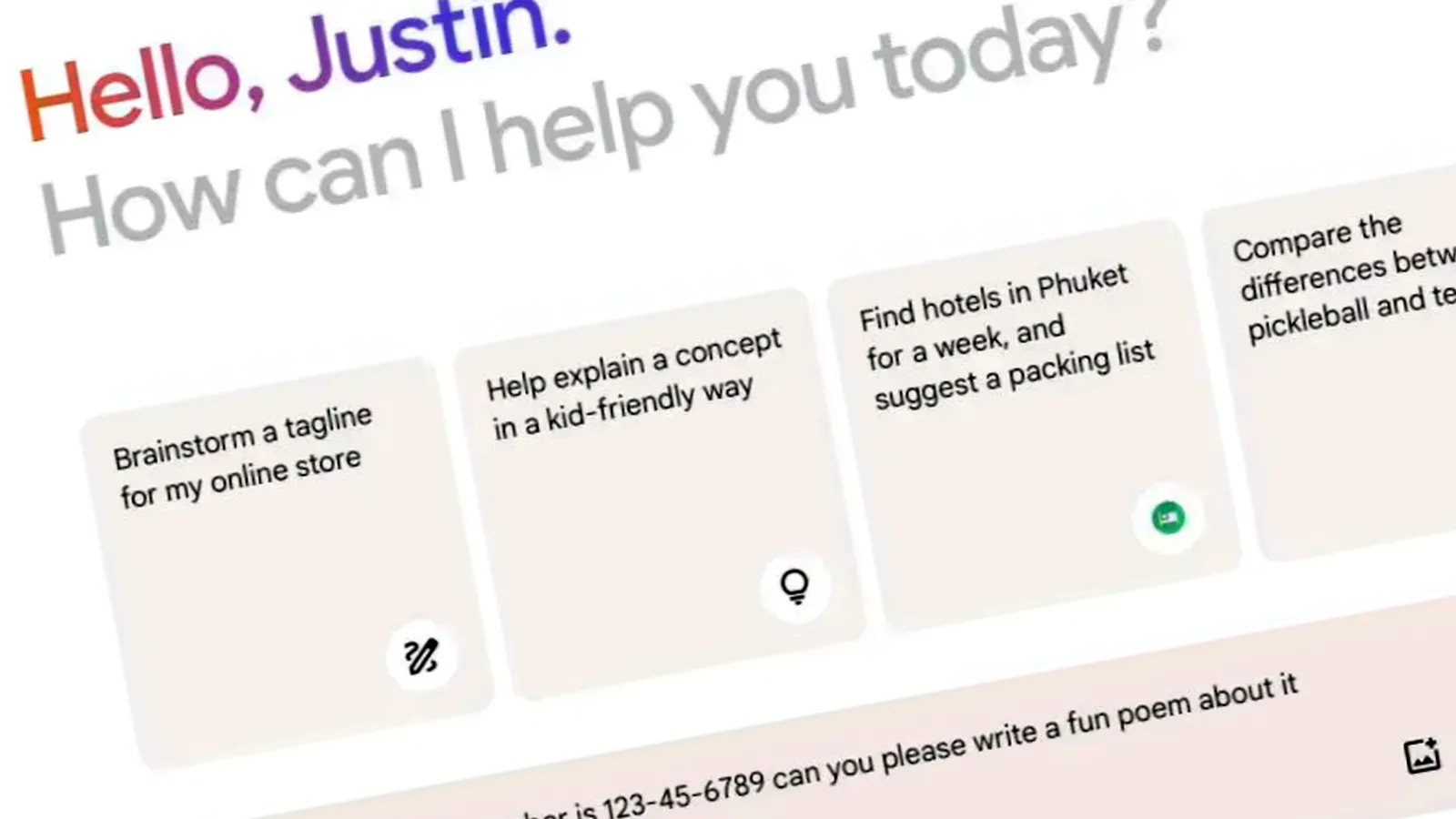

Jack Wallen, penulis di ZDNet, ngebahas tentang pernyataan privasi dari Google Gemini. Ini adalah chatbot AI yang dulu namanya Bard. Di situ ditulis kalau semua informasi di obrolan dengan Gemini disimpen selama tiga tahun dan sering direview sama manusia.

Dokumennya juga bilang, jelas-jelas, kalau kamu nggak boleh pake layanannya buat hal-hal yang privasi. Ini kutipannya: "Kami dapat menggunakan informasi yang kami kumpulkan dari Anda untuk meningkatkan produk dan layanan kami, termasuk layanan Gemini. Kami juga dapat menggunakan informasi tersebut untuk memberi Anda konten dan iklan yang dipersonalisasi, dan untuk mengukur efektivitas periklanan kami. Kami dapat berbagi informasi dengan afiliasi, mitra, dan pihak ketiga kami yang menyediakan layanan kepada kami atau atas nama kami, seperti komputasi awan, analitik, dan pemasaran. Kami juga dapat membagikan informasi sebagaimana diwajibkan oleh hukum, atau untuk melindungi hak dan properti kami, atau hak dan properti orang lain". Ini artinya Google bilang, dengan bahasa yang gampang dimengerti, kalau manusia bisa aja ngeliat obrolanmu dan pake itu buat ngembangin produk AI mereka.

Nah, apakah ini berarti Gemini bakal ngulang informasi privasi yang kamu ketik di kotak chat, kayak chatbot AIM gue yang jelek itu? Nggak juga, dan di halamannya juga ditulis kalau reviewer manusia kerjanya ngapus data yang jelas-jelas privasi kayak nomor telepon atau email. Tapi ada kebocoran ChatGPT akhir tahun lalu, di mana seorang peneliti keamanan bisa akses data latihannya, yang nunjukkin kalau apa pun yang dimiliki sama LLM bisa aja, setidaknya secara teori, bocor suatu saat.

Dan ini semua asumsinya perusahaan yang ngelola chatbotmu itu berusaha jujur. Google dan OpenAI punya kebijakan privasi yang jelas yang bilang mereka nggak jual informasi pribadi. Tapi Thomas Germain, penulis di Gizmodo, ngelaporin kalau ada AI "pacar" yang ngajak pengguna buat berbagi informasi privasi dan malah menjualnya.

Dari artikelnya: "Chatbots, yang didukung oleh kecerdasan buatan, dapat mengumpulkan banyak informasi intim tentang pengguna melalui percakapan yang terdengar alami, menurut para peneliti yang telah mempelajarinya. Perusahaan di balik chatbot kemudian menggunakan data tersebut untuk melatih dan meningkatkan perangkat lunak mereka, dan beberapa menjualnya kepada pihak ketiga seperti pemasar, platform e-niaga, dan pialang data.". Jadi nggak cuma data chatmu yang bisa bocor, tapi ada juga perusahaan di bidang AI yang sengaja ngumpulin dan jual informasi privasi.

Kesimpulannya, jangan pernah ngomongin hal-hal yang privasi sama LLM apapun. Ini berarti hal-hal yang jelas, kayak nomor Social Security, nomor telepon, atau alamat, tapi juga hal-hal lain yang kamu nggak mau dibocorin. Aplikasi-aplikasi ini emang nggak ditujukan buat informasi privasi.